Компанията за киберсигурност ESET разкри, че е открила вариант на зловреден софтуер (ransomware), задвижван от изкуствен интелект (AI), с кодово име PromptLock. Написан е на Golang - език за програмиране с отворен код, разработен в Google и по-известен като Go. Новооткритият компютърен вирус използва модела gpt-oss:20b от OpenAI локално, за да генерира злонамерени скриптове в реално време. "PromptLock използва Lua скриптове, (...) за да изброи локалната файлова система, да провери целевите файлове, да извлече избрани данни и да извърши криптиране", обявиха от ESET.

Още: Кои са най-опасните компютърни вируси?

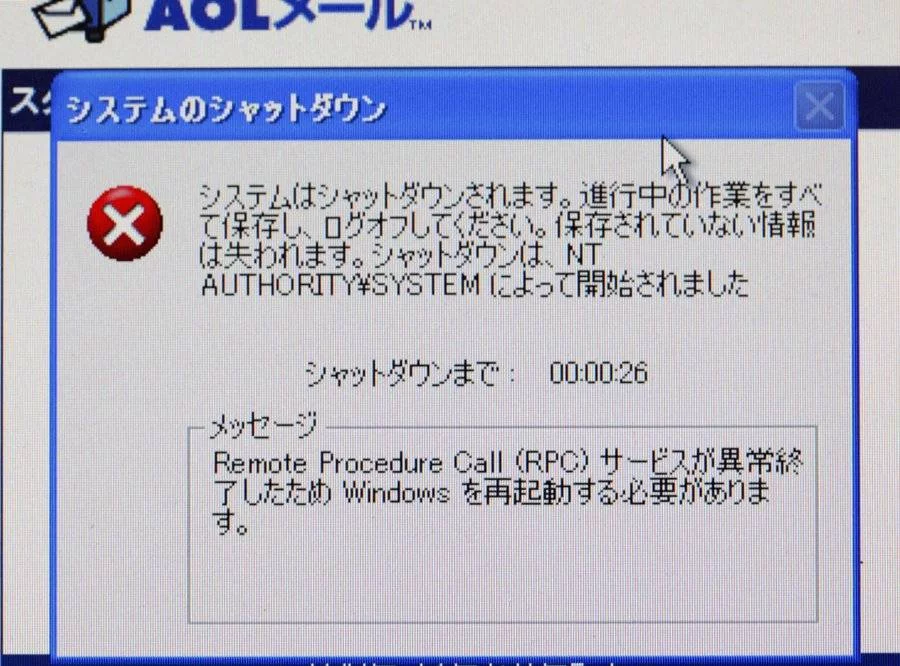

Вирусът функционира в Windows, Linux и macOS

"Тези Lua скриптове са съвместими с различни платформи и функционират на Windows, Linux и macOS".

Кодът на злонамерения софтуер също така съдържа инструкции за създаване на персонализирано съобщение въз основа на "засегнатите файлове" и въз основа на това дали заразената машина е персонален компютър, фирмен сървър или контролер.

Понастоящем не е известно кой стои зад зловредния софтуер, но ESET съобщава пред специализираното издание The Hacker News, че части от PromptLoc са били качени на VirusTotal от локация в САЩ на 25 август - т.е. преди три дни.

Researchers have discovered the first virus created using AI.

— NEXTA (@nexta_tv) August 27, 2025

ESET Research Labs announced the discovery of the first ransomware created with the help of artificial intelligence.

The new virus, named PromptLock, uses a model from OpenAI to generate Lua scripts on the fly.… pic.twitter.com/1dvFXTxzvW

Защо се открива трудно?

"PromptLock използва Lua скриптове, генерирани от AI, което означава, че индикаторите за компрометиране (IoC) могат да варират между изпълненията", посочва словашката компания за киберсигурност.

"Тази променливост създава предизвикателства за откриването. Ако се приложи правилно, такъв подход може значително да усложни идентифицирането на заплахите и да затрудни задачите на защитниците".

Още: В ерата на изкуствения интелект имаме все по-голяма нужда от естествен такъв

С какво е опасен PromptLock?

PromptLock не е оценен като напълно функциониращ зловреден софтуер. Той използва 128-битовия алгоритъм за криптиране SPECK, за да заключва файлове. Освен за криптиране, може да се използва и за извличане на данни или дори за унищожаването им, въпреки че функционалността за действително изтриване все още не изглежда да е приложена.

"PromptLock не изтегля целия модел, който може да е с размер от няколко гигабайта", поясняват от ESET. „Вместо това атакуващият може просто да създаде прокси или тунел от компрометираната мрежа към сървър, на който се изпълнява Ollama API с модела gpt-oss-20b".

Появата на PromptLock е още един знак, че изкуственият интелект е улеснил киберпрестъпниците - дори тези, които нямат технически познания - да създават бързо нови кампании, да разработват зловреден софтуер и да създават привлекателно фишинг съдържание и злонамерени сайтове.

Още: 10 съвета как да се предпазим от компютърни вируси

Снимка: Getty Images/Guliver

Повишена опасност с AI

Това се случва в момент, в който уязвими на атаки с променливи "инжекции" са големите езикови модели (LLM), които захранват различни чатботове и инструменти за разработчици, фокусирани върху изкуствения интелект, като Amazon Q Developer, Anthropic Claude Code, AWS Kiro, Butterfly Effect Manus, Google Jules, Lenovo Lena, Microsoft GitHub Copilot, OpenAI ChatGPT Deep Research, OpenHands, Sourcegraph Amp и Windsurf. Това потенциално позволява разкриване на информация и изтичане на данни.

Въпреки че включват надеждни защитни механизми за сигурност и безопасност, за да се избегнат нежелани поведения, AI моделите многократно са ставали жертва на нови варианти на "инжекции", което подчертава предизвикателството за сигурността.

Още: Нов вирус "Azov" унищожава данните, труден и за експертите

"Атаките с променливи инжекции могат да накарат AI да изтрива файлове, да краде данни или да извършва финансови трансакции. Нови форми на атаки с променливи инжекции също се разработват постоянно от злонамерени лица", казват от фирмата Anthropic - компания, занимаваща се с безопасност и изследвания в областта на AI.

Има хакове, които да се вкарат в кода и така да заобикалят милиони долари, инвестирани в изследвания за безопасността на изкуствения интелект, посочва Adversa AI в доклад, публикуван миналата седмица.

Още: Кои са най-често срещаните видове компютърни вируси?